⏶3

TRiSM 面向智能体AI:基于大型语言模型的智能体多智能体系统中的信任、风险和安全管理综述

发表

由  Ranjan Sapkota 提交

Ranjan Sapkota 提交

作者:  Shaina Raza, Ranjan Sapkota, Manoj Karkee, Christos Emmanouilidis

Shaina Raza, Ranjan Sapkota, Manoj Karkee, Christos Emmanouilidis

摘要

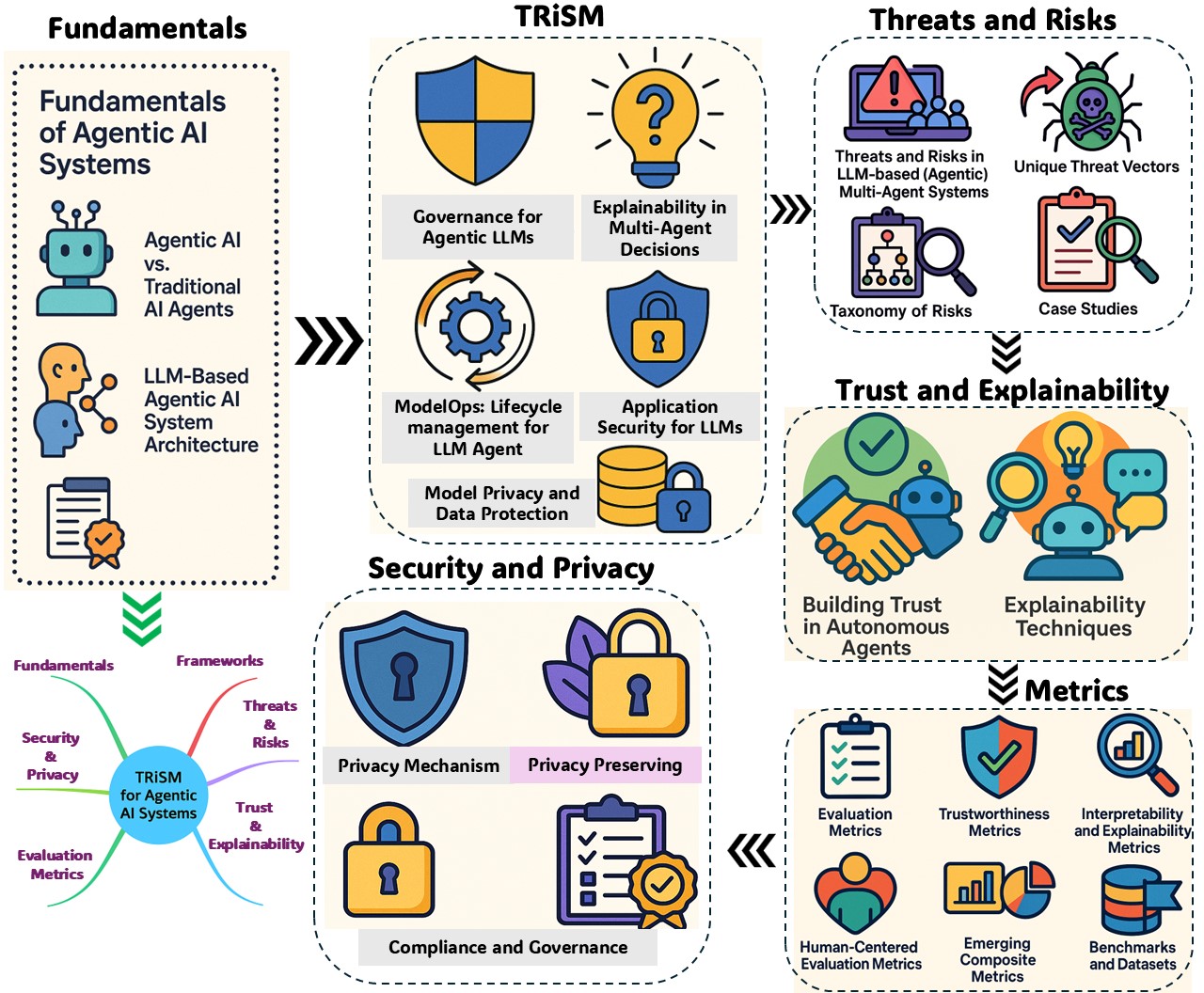

基于大型语言模型(LLM)并以多智能体配置部署的智能体AI系统,正在重新定义企业和社会领域中的智能自主性、协作和决策制定。本综述对基于LLM的智能体多智能体系统(AMAS)中的信任、风险和安全管理(TRiSM)进行了结构化分析。我们首先审视了智能体AI的概念基础、其与传统AI智能体的架构差异,以及实现可扩展、工具使用自主性的新兴系统设计。然后,通过治理、可解释性、ModelOps以及隐私/安全这四个支柱,详细阐述了智能体AI框架中的TRiSM,并分别为智能体LLM进行了情境化。我们识别了独特的威胁向量,并为智能体AI应用引入了全面的风险分类法,并辅以案例研究以说明现实世界中的漏洞。此外,本文还调查了分布式LLM智能体系统中的信任构建机制、透明度和监督技术,以及最先进的可解释性策略。此外,还审查了评估信任、可解释性和以人为中心性能的指标,以及开放基准测试挑战。安全和隐私通过加密、对抗性防御以及遵守不断发展的AI法规来解决。本文最后提出了负责任智能体AI的路线图,提出了研究方向,以使新兴的多智能体系统与稳健的TRiSM原则对齐,实现安全、负责和透明的部署。

基于大型语言模型(LLM)并以多智能体配置部署的智能体AI系统,正在重新定义企业和社会领域中的智能自治、协作和决策。本综述对基于LLM的智能体多智能体系统(AMAS)中的信任、风险和安全管理(TRiSM)进行了结构化分析。我们首先探讨智能体AI的概念基础、其与传统AI智能体的架构差异,以及实现可扩展、工具使用型自治的新兴系统设计。接着,智能体AI框架中的TRiSM通过治理、可解释性、ModelOps和隐私/安全这四大支柱进行详细阐述,并针对智能体LLM进行了具体化。我们识别了独特的威胁载体,并为智能体AI应用引入了一个全面的风险分类体系,辅以案例研究来说明现实世界的漏洞。此外,本文还考察了分布式LLM智能体系统中的信任建立机制、透明度和监督技术,以及最先进的可解释性策略。此外,还回顾了评估信任、可解释性和以人为中心性能的指标,以及公开基准测试的挑战。安全和隐私通过加密、对抗性防御以及遵守不断发展的AI法规来解决。本文最后提出了负责任智能体AI的路线图,建议研究方向,以使新兴的多智能体系统符合稳健的TRiSM原则,实现安全、负责和透明的部署。